新算法具有卓越的性能表現,可以有效節省高達 70%的大模型推理 RAM 佔用,AI 大模型提供更多的空間,提供強有力的支援。" Q( o+ @$ J4 p8 s

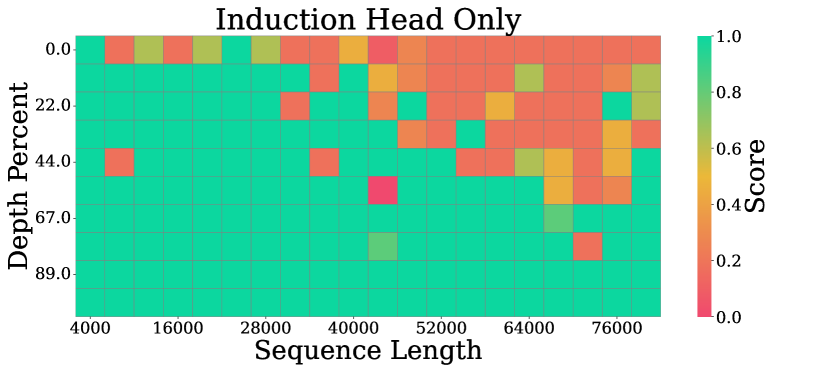

新算法具有卓越的性能表現,可以有效節省高達 70%的大模型推理 RAM 佔用,AI 大模型提供更多的空間,提供強有力的支援。" Q( o+ @$ J4 p8 s 目前相關論文《RazorAttention: Efficient KV Cache Compression Through Retrieval Heads》已被深度學習領域國際頂級會議 ICLR 2025 收錄,可見其重要性。www2.tvboxnow.com5 z4 A) M3 r: w3 ?. X! ?" H

目前相關論文《RazorAttention: Efficient KV Cache Compression Through Retrieval Heads》已被深度學習領域國際頂級會議 ICLR 2025 收錄,可見其重要性。www2.tvboxnow.com5 z4 A) M3 r: w3 ?. X! ?" H| 歡迎光臨 公仔箱論壇 (http://www2.tvboxnow.com/) | Powered by Discuz! 7.0.0 |